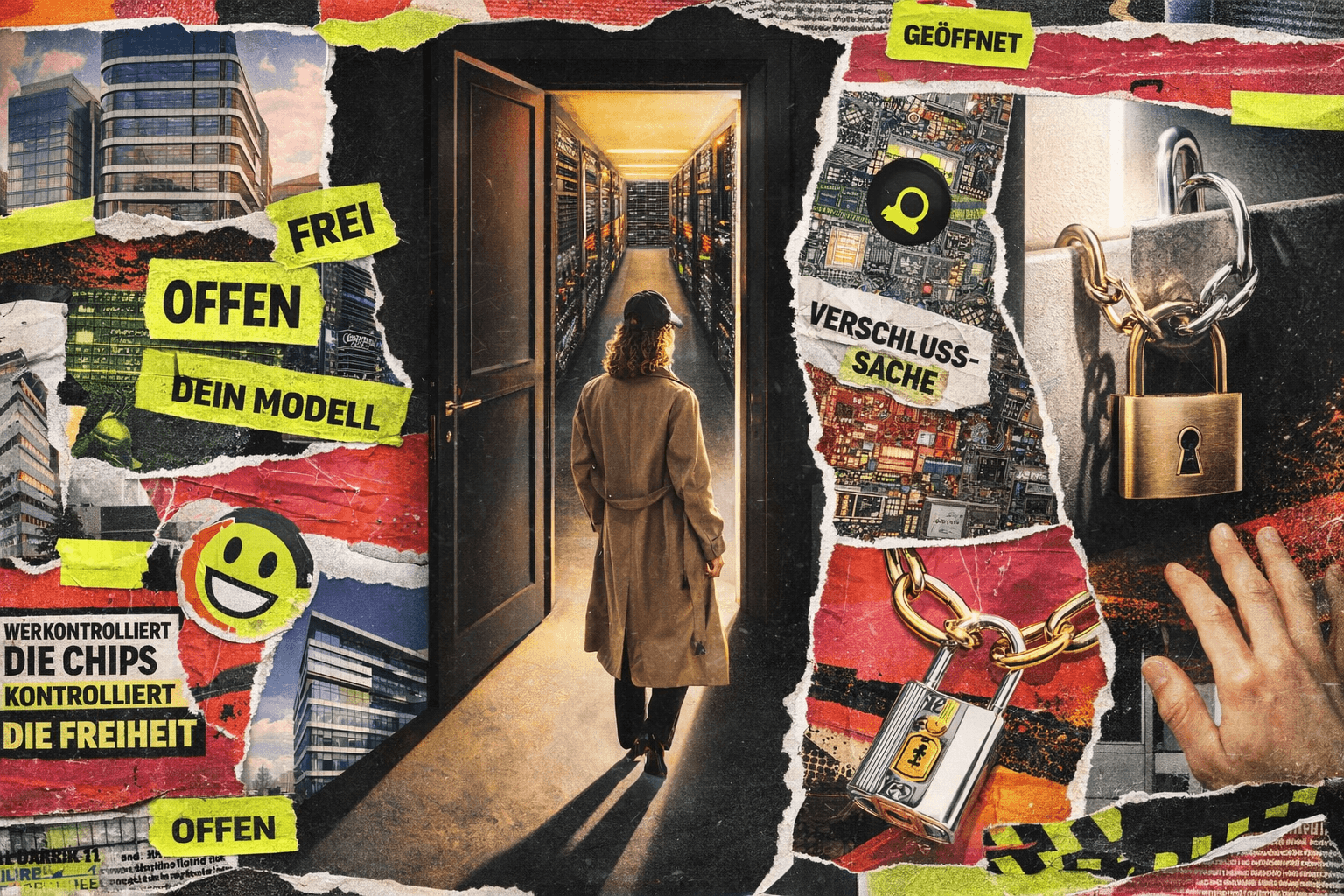

Nvidia verschenkt jetzt KI-Modelle. Was steckt dahinter?

Gemma 4, Nemotron 3 Super - beide "offen". Aber nicht gleich offen. Was der Unterschied zwischen Open Weight und Open Source für dein Unternehmen wirklich bedeutet.

Christopher Thanisch ist Gründer von Syndikat. Jede Woche schreibt er in seiner Kolumne „Drops“ über die neuesten Entwicklungen und Trends im Bereich KI.

Innerhalb von acht Tagen haben zwei der größten Tech-Unternehmen der Welt ihre KI-Modelle "geöffnet". Google am 2. April mit Gemma 4. Nvidia kurz vorher auf der GTC in San José mit Nemotron 3 Super. Beide nennen es offen. Beide lügen dabei ein bisschen.

Im Oktober 2024 hat die Open Source Initiative (OSI) zum ersten Mal eine klare Definition für "Open Source AI" verabschiedet - OSAID 1.0. Die Anforderung: Weights + vollständiger Trainings-Code + Trainingsdaten. Alle drei. Fehlt eines davon, ist es kein Open Source - es ist Open Weight.

Klingt technisch. Hat aber direkte rechtliche und strategische Konsequenzen für jedes Unternehmen das KI produktiv einsetzt.

Wenn die Trainingsdaten unbekannt sind, kann niemand unabhängig prüfen ob urheberrechtlich geschütztes Material genutzt wurde. Ob bestimmte Branchen oder Perspektiven systematisch benachteiligt werden. Ob das Modell in deinem Use Case Lücken hat, die du nie entdecken wirst weil du nicht weißt, was beim Training gefehlt hat.

Schau dir die bekanntesten Modelle an: Llama 4 von Meta? Open Weight. Trainingsdaten: geheim. Mistral? Open Weight. GPT-OSS-120B von OpenAI? Open Weight. Gemma 4 von Google? Open Weight - auch wenn die Lizenz Apache 2.0 ist, was sich gut anfühlt. Die Weights sind frei. Die Daten nicht.

Die Modelle die tatsächlich OSAID-konform sind heißen OLMo (Allen Institute for AI) und Pythia (EleutherAI). Beide akademische Projekte. Beide performen deutlich schwächer. Fast niemand redet darüber.

Jetzt kommt die Wendung.

Nemotron 3 Super von Nvidia ist das transparenteste Modell das ein Frontier-Anbieter je released hat. 120 Milliarden Parameter, davon nur 12 Milliarden aktiv pro Inferenz (Mixture-of-Experts-Architektur). 1 Million Token Kontext. Und dazu: 153 Trainingsdatensätze mit über 10 Billion Tokens, komplette Trainings-Recipes, alle RL-Umgebungen.

Mehr Offenheit als Google, Meta und OpenAI zusammen.

Und trotzdem: Die Lizenz ist die NVIDIA Open Model License. Selbst geschrieben. Nicht OSI-konform.

Nvidia schreibt die Lizenz selbst, weil sie es können. Rund 90% Marktanteil bei Datacenter-GPUs gibt dir diese Freiheit.

Nvidia hält rund 90% Marktanteil bei Datacenter-GPUs - 216 Milliarden Dollar Umsatz im letzten Geschäftsjahr. Offene Modelle sind für Nvidia Marketing - die effektivste Art die es gibt. Nemotron 3 Super läuft am besten auf Blackwell-Chips. Mit NVFP4-Quantisierung: 5x höherer Throughput als auf anderen Setups. Die "offenen" Trainings-Recipes führen direkt in NVIDIAs Entwicklungs-Ökosystem.

Das freie Modell ist das Trojanische Pferd für die Hardware.

Wer gewinnt. Wer verliert.

Nvidia gewinnt klar - das ist keine Prognose mehr, das ist laufende Realität. Jedes Deployment von Nemotron ist ein Hardware-Sale. Jeder Entwickler der mit NVIDIAs Training-Recipes arbeitet, bleibt im NVIDIA-Stack. Und solange rund 90% aller KI-Infrastruktur auf NVIDIA-Chips läuft, ist das ein sehr stabiler Burggraben.

OpenAI und Anthropic stehen unter ernstem Preisdruck. Was vor 18 Monaten nicht für jeden Preis verfügbar war, kostet heute via API 20 Cent pro Million Tokens - Frontier-Modell-Qualität. Die Differenzierungsfrage ist berechtigt: Was rechtfertigt noch das Zehnfache?

Deutschland und die EU verlieren strukturell. Open-Source-Modelle sind frei verfügbar - aber Training und High-Performance-Inference laufen auf Hardware die fast ausschließlich von NVIDIA kommt. KI-Souveränität bleibt eine politische Ambition ohne technologisches Fundament solange Blackwell-Chips importiert werden müssen.

Mittelständler mit eigener IT-Infrastruktur können gewinnen - wenn sie jetzt die richtigen Entscheidungen treffen. Gemma 4 E4B läuft auf einer Consumer-GPU. On-Premise-Inference für datenschutzkritische Prozesse ist realistisch geworden. Das war vor zwei Jahren noch nicht der Fall.

Was das für dein Unternehmen konkret bedeutet

Vier Dinge die ich sofort angehen würde:

Lizenz-Check machen. "Open" bedeutet nicht "rechtlich gecheckt". Jedes KI-Modell das ihr produktiv einsetzt braucht eine Lizenz-Due-Diligence. NVIDIA Open Model License ist nicht Apache 2.0. Apache 2.0 ist nicht OSAID-konform. Das sind drei verschiedene Risikoprofile - und deine Rechtsabteilung muss wissen welches ihr trägt.

IP-Risiko einordnen. Wenn ihr KI-generierte Outputs kommerziell nutzt: Können eure Modelle erklären, auf welchen Daten sie trainiert wurden? Bei Open Weight lautet die ehrliche Antwort: nein. Das ist eine offene Haftungsfrage die sich in den nächsten 12-18 Monaten durch erste Urteile zu KI und Urheberrecht weiter konkretisieren wird.

API-Kosten überprüfen. Falls ihr noch bei Legacy-Preisen für Frontier-Modelle hängt: $0.20 pro Million Tokens ist keine Ausnahme mehr - das ist die neue Realität. Ein Anbieter-Review lohnt sich.

Self-Hosting realistisch kalkulieren. Gemma 4 E4B läuft auf Consumer-GPUs - On-Premise-Inference für Datenschutz-Anforderungen ist bei kleineren Modellen jetzt praktikabel. Nemotron 3 Super braucht 8x H100 - das ist kein Mittelstand-Szenario. Die Modellauswahl bestimmt die Hardware-Anforderung.

Offene Modelle verlagern Abhängigkeit - von Software-Lock-In zu Hardware-Lock-In. Wer das weiß, trifft eine andere Entscheidung.

Ich hab vor ein paar Wochen einem Kunden geraten, Open-Weight-Modelle als "quasi Open Source" zu bezeichnen - im internen Strategie-Dokument, als Argument für mehr Investition. Ich hab das so geschrieben weil es einfacher war als den Unterschied zu erklären.

Falsch. Der Datenschutzbeauftragte hat genau an diesem Punkt nachgehakt. Wir haben zwei Wochen verloren weil wir die Frage nach den Trainingsdaten nicht sauber beantwortet hatten.

Seitdem erkläre ich den Unterschied immer zuerst.

Schick diese Ausgabe an deinen IT-Leiter. Die Frage ob ihr Open Weight oder Open Source einsetzt ist keine akademische - sie ist eine Compliance- und Strategiefrage. Und gerade jetzt, wo die Modelle besser und die Entscheidungsgrundlagen gleichzeitig undurchsichtiger werden, ist es der richtige Zeitpunkt sie zu stellen.

Diesen Drop teilen

Newsletter

Kein Drop verpassen.

Jeden neuen Essay direkt in dein Postfach. Kein Spam, kein Bullshit - nur Syndikat Drops.